第一节:机器翻译评估的挑战

在评估机器翻译(Machine Translation, MT)系统的性能时,最理想的方式是聘请双语专家进行人工评分。然而,随着深度学习模型的快速迭代,人工评估面临着不可逾越的瓶颈:

高昂的成本: 大规模语料库的翻译评估需要耗费大量的人力财力。

低下的效率: 人工评分无法实时反馈给开发者,难以嵌入到模型训练的损失函数或验证流程中。

主观性偏差: 不同评审员对“好翻译”的标准不一,导致评分缺乏绝对的一致性。

为了解决上述问题,研究者们寻求一种自动化的评估指标。其核心思想在于:如果机器翻译的结果与人类提供的参考译文(Reference)越接近,那么该系统的性能就越优秀。

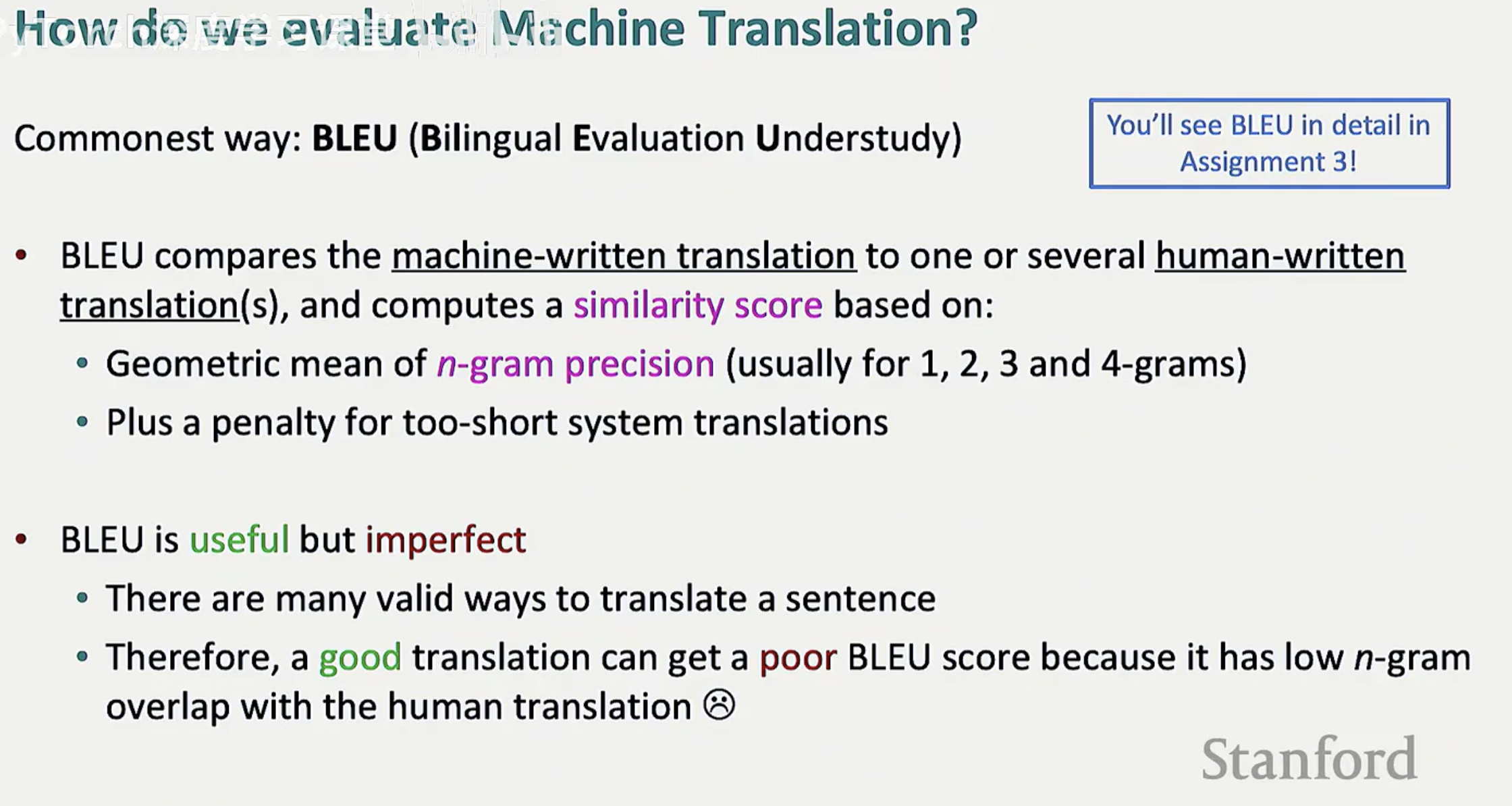

在众多的自动评估方法中,BLEU (Bilingual Evaluation Understudy) 是应用最广泛、最具代表性的指标。它通过计算机器译文与参考译文之间的 n-gram 重合度,为翻译质量提供了一个可量化的相似度分数。

第二节:BLEU 的核心计算机制

BLEU 的设计目标是寻找一种能够衡量机器译文(Candidate)与人类参考译文(Reference)之间召回精度的自动指标。其核心计算逻辑由两个关键维度构成:

1. n-gram 精度 (n-gram Precision)

n-gram 是指连续出现的 n 个单词序列。BLEU 分别计算 1-gram, 2-gram, 3-gram 和 4-gram 的精度:

1-gram (Unigrams): 衡量单词翻译的准确性(是否有这些词)。

2-gram to 4-gram: 衡量翻译的流畅度(词与词之间的衔接是否自然)。

为了避免模型通过重复单个正确单词(如反复输出 "the")来刷分,BLEU 使用了修正的精度(Modified Precision),即对匹配到的 n-gram 数量进行截断处理,确保其不超过参考译文中该序列出现的最大次数。

最终,BLEU 取这四个精度值的几何平均值(Geometric Mean)。采用几何平均而非算术平均,是为了确保如果其中任何一个阶数的精度极低,整体分数都会受到显著惩罚。

2. 短句惩罚因子 (Brevity Penalty, BP)

单纯依靠精度会导致一个漏洞:如果机器只翻译了原句中非常有把握的三个词,虽然精度(Precision)可能达到 100%,但它丢失了大部分信息。

为了解决这一问题,BLEU 引入了 BP 惩罚因子:

当机器译文长度 大于或等于 参考译文时,BP = 1(不惩罚)。

当机器译文长度 小于 参考译文时,BP 会随长度缩减而指数级下降。

通过将 n-gram 精度与 BP 因子相乘,BLEU 同时兼顾了翻译的准确性与完整性。

第三节:多参考答案机制与匹配逻辑

语言的一个核心特征是表达的多样性。对于同一句源文本,不同的翻译人员可能会给出词汇选择、句式结构完全不同但语义均准确的参考译文。

如果自动评估指标仅对比单一参考答案,那么一个优秀的机器翻译可能会因为使用了同义词(例如将 "International Airport" 翻译为 "Air Terminal")而被打低分。为了缓解这一问题,BLEU 引入了多参考答案(Multiple Reference Translations)的匹配机制。

1. 跨参考答案的 n-gram 匹配

如上图所示,当机器翻译输出一个句子时,BLEU 会将其中的每一个 n-gram 片段与所有提供的人类参考答案进行比对。只要该片段出现在任何一个参考答案中,即被视为一次成功的匹配。

逻辑示例: 即使参考答案 1 中没有出现某个短语,只要参考答案 2 或 3 中包含了该短语,机器翻译依然可以获得相应的精度分数。

效果: 这种机制显著提升了评估的容错率,使指标更能捕捉到翻译的灵活性。

2. “期望值”下的评估趋势

尽管最初的 BLEU 论文建议使用多个参考答案以获得更稳健的评估,但在现代工业界和学术论文中,由于获取多份高质量人工翻译的成本极高,通常仅使用一份参考答案进行评测。

在这种情况下,单句的 BLEU 分数波动会变大,但通过在整个测试集(Test Set)上计算平均分,BLEU 依然能够展现出极强的统计显著性。这种在大规模语料上的表现,我们称之为“在期望意义上”(In expectation)的准确性。

第四节:BLEU 的局限性

尽管 BLEU 是目前机器翻译领域最通用的自动评估指标,但它并非完美无缺。其核心局限性在于它是一种基于字面重合度(Surface-level Overlap)的统计方法,而非基于语义理解(Semantic Understanding)。

1. 语义等价与字面缺失

BLEU 无法处理同义词(Synonyms)。如果参考译文使用的是 "quick",而机器翻译使用的是 "fast",即便两者在语义上完全等价,BLEU 也会因为 n-gram 不匹配而将其判定为错误并扣分。

2. 语序灵活性的挑战

对于语序相对自由的语言(如中文或德语),同一意思可以有多种合法的排列组合。BLEU 强行匹配连续的 n-gram,可能导致一些语法正确但语序稍异的高质量翻译得分偏低。

3. 缺乏对“重要词汇”的区分

在 BLEU 的计算中,虚词(如 "the", "a", "is")与核心实词(如动词、名词)具有相似的权重。这意味着:

一个翻译可能在核心语义上完全错误(例如漏掉了 "not"),但因为匹配了大量的虚词,依然能获得不错的 BLEU 分数。

这种“虚假的高分”往往无法反映真实的翻译质量。

4. 与人类认知的鸿沟

研究表明,BLEU 分数与人类感知的翻译质量(Fluency & Adequacy)之间并非线性相关。尤其是在单句层面,高 BLEU 分数并不一定代表高质量翻译,反之亦然。

结论: BLEU 更多地是衡量“翻译的相似程度”,而非“翻译的正确程度”。因此,它通常被视为评估模型性能的下限而非上限

第五节:机器翻译的演进与 BLEU 分数的跃迁

回顾过去十年的技术路线,机器翻译经历了从统计模型到神经网络模型的范式转移。通过观察不同时期主流模型的 BLEU 分数走势,我们可以清晰地看到技术迭代带来的质量红利。

1. 统计机器翻译(SMT)的瓶颈期

在 2013 年至 2015 年间,基于短语(Phrase-based SMT)和基于语法(Syntax-based SMT)的模型占据主导地位。

表现: 这一时期的 BLEU 分数增长非常缓慢,通常维持在 20-25 分左右(以 WMT 评测集为例)。

局限: SMT 依赖于人工设计的复杂规则和短语对照表,难以处理长距离的语义依赖。

2. 神经机器翻译(NMT)的爆发

2015 年是机器翻译的分水岭。随着循环神经网络(RNN)和注意力机制(Attention)的引入,神经机器翻译(Neural MT)正式登场。

斜率陡增: 如图中蓝线所示,NMT 的 BLEU 分数呈现出近乎线性的高速增长。

突破: 到了 2019 年(如 FAIR 的模型),BLEU 分数已经突破了 40 分大关。这意味着机器生成的译文在 n-gram 重合度上已经达到了极高的水平,翻译的流畅度和准确性有了质的飞跃。

总结:BLEU 的持久生命力

尽管前文提到了 BLEU 的种种局限,但它依然是自然语言处理(NLP)领域最成功的评估指标之一。它简单、快速且具备极高的基准价值。

当我们看到 BLEU 分数从 20 提升到 40 时,它不仅是一串数字的变动,更代表了人类在弥合语言鸿沟这一终极目标上迈出的坚实步伐。对于开发者而言,理解 BLEU 的计算逻辑和演进历史,是优化翻译模型、探索更高级语义评估指标(如 COMET 或 BERTScore)的必经之路。