这篇论文 《On the Influence of Context Size and Model Choice in Retrieval-Augmented Generation Systems》 发表在 NAACL 2025(北美计算语言学协会年会)的 Findings 子刊上。

1. 引言

RAG系统通过集成检索组件来增强大型语言模型(LLMs)的能力,该组件使模型能够在生成过程中动态利用外部知识来源。通过从精选语料库或网络中实时检索相关信息,RAG模型能够生成更准确、更及时且符合上下文的响应。 RAG系统已在各行各业得到广泛应用,企业利用这些系统构建工具,通过自然语言提问来访问其内部文档。

尽管其受欢迎程度和应用范围日益扩大,但迄今为止鲜有研究系统地探讨RAG系统的各种配置,包括上下文长度、基础大语言模型的选择以及检索器技术(稀疏或密集)的选择。尽管近期研究表明,长上下文块中的关键信息可能会“迷失在中间” 或受噪声上下文影响,但这些研究大多针对短篇事实型问答(如“谁获得了2024年诺贝尔和平奖?”),且假设存在一个与答案相关的黄金上下文片段。 关于大型语言模型(LLMs)如何在长文问答中利用上下文的研究相对较少,而在这种场景下,完整的最终答案必须包含多个甚至全部上下文片段。

为弥合这一研究空白,本研究旨在探索和评估RAG系统的各种配置方案。 系统性地研究了不同的上下文规模、检索策略以及基础大语言模型(LLMs)如何影响RAG 系统的性能。通过生成式问答任务这一视角,在两个不同领域对这些参数进行了评估:生物医学领域的 BioASQ-QA 任务和百科全书领域的 QuoteSum 数据集。

考察了提示词(prompt)中上下文片段数量对 RAG 系统最终任务表现的影响。随着片段数量从 1 个增加到约 10-15 个,系统表现稳步提升,但在达到 20-30 个片段时,表现开始停滞甚至出现下降。

测试了不同规模的多种大型语言模型(LLM)在利用上下文片段生成准确答案方面的表现。结果表明,Mistral 和 Qwen 在生物医学任务中表现最佳,而 GPT 和 Llama 则在百科全书任务中表现突出。

测试了开放域场景,即标准答案未知且必须从大型知识库中检索的情况。评估了两种不同的检索器,并展示了其对最终性能的影响。其中发现该场景极具挑战性,其BM25性能远不及标准场景,而语义检索则能提供更广泛的信息覆盖。

2. 相关工作

2.1 检索增强生成

RAG方法分为“基础型RAG”和“高级型RAG”。基础型RAG方法遵循传统的处理流程,包括索引、检索和生成,也被称为“先检索后阅读”框架。

先进RAG通过采用检索前和检索后策略,引入了具体的改进措施以提升检索质量。检索前策略包括利用大型语言模型(LLM)进行查询重写或采用HyDE等查询扩展方法。 检索后处理方法则侧重于从检索到的文档中筛选出关键信息。这包括利用神经网络模型对检索到的文档进行重新排序,或在将检索到的文档作为上下文传递之前对其进行摘要处理。

2.2 RAG系统的上下文与噪声

虽然也有也有研究探讨了输入上下文的规模及其对RAG 系统性能的影响。但它们主要是在多项选择题或简答型问答任务上进行评估,这类任务通常只有一个明确的答案和一个最重要的上下文片段。

而本论文的研究则针对生成式问答进行评估,在该场景下所有片段都可能与答案相关,这是一种更具挑战性的设置。此外,还对 RAG 的三个主要组成部分进行了全面评估:上下文规模的影响、不同的检索技术以及基础大语言模型(LLMs)的选择。

3. 基本

3.1 用于问答的RAG系统

通常,一个RAG系统由检索器和阅读器组成。检索器需要搜索并收集相关证据片段,这些片段作为上下文通过提示传递给阅读器。

本论文探讨了这三个方面(检索器、上下文、阅读器)对整个系统最终性能的重要性。

首先关注上下文大小对阅读器问答能力的影响,随后通过比较不同基础大语言模型(LLMs)在该任务中的表现,探讨选择阅读器的重要性,最后测试两种不同检索器(BM25 和语义搜索)对最终问答性能的影响。

给定一个问题 q 和由上下文片段 c1 , c2 , ... , cn组成的上下文 c,目标是生成一个答案 a,使得模型reader(q, c) = a。上下文 c 是在第一个实验中已提供,但在开放领域设置下,给定文档语料库 D,其中包含文档 d1、d2、...、dN,其思路是让检索器检索出 (q, D) = d1, d2 这两个最匹配的文档,然后从中提取上下文片段。

3.2 数据集

BioASQ-QA:是一个英文生物医学问答(QA)基准数据集。该数据集旨在反映生物医学专家的实际信息需求。 问题由生物医学专家撰写,用于回答问题的证据语料库是 PubMed,这是一个庞大的生物医学研究论文数据库。

QuoteSum;是一个包含百科全书式问题、相关段落以及人工撰写的半提取式答案的数据集。

4. 实验

4.1 模型

使用多种不同的LLM作为“阅读器”进行实验,即负责阅读和理解上下文的模型,随后据此生成答案。

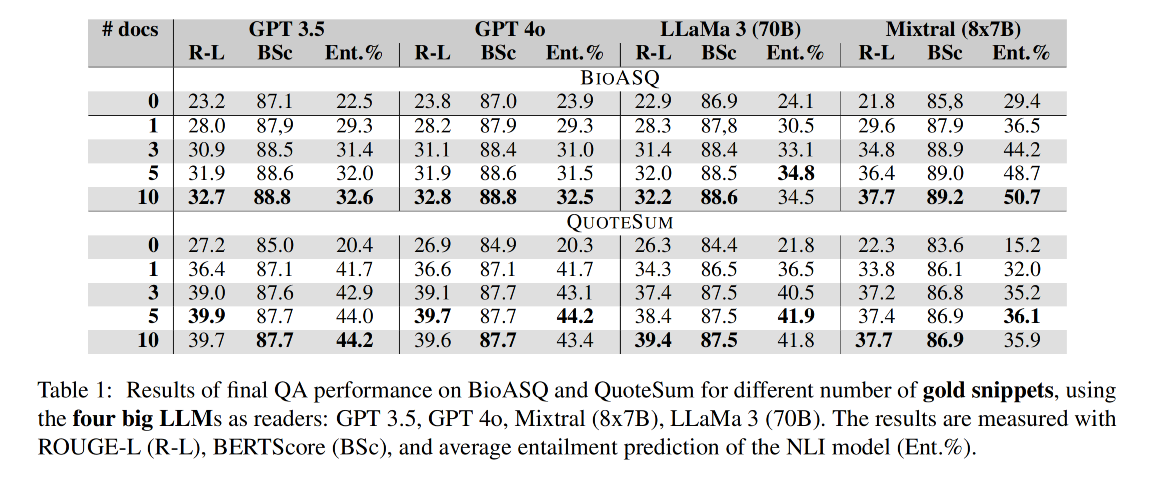

较大模型:GPT-4o,GPT-3.5,LLaMa 3(70B),Mixtral(8x7B)

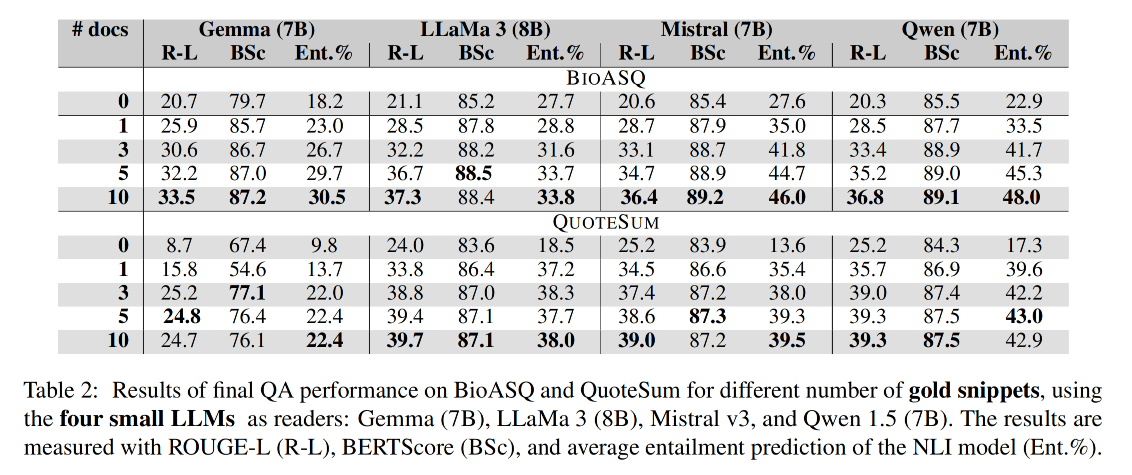

较小模型:Mistral(7B),Gemma(7B),LLaMa 3(8B),Qwen(7B)

4.2 实验设置

对所有参测模型采用相同的提示词和设置。

4.3 实验轮次

上下文规模与阅读器性能。第一轮实验通过改变提示词中传递的上下文片段数量,观察问答性能的变化。

作为起点,首先向大语言模型(LLMs)提出问题,且不提供任何上下文(0个片段),以此测试其内部知识的调用能力,将其作为基准。随后,将上下文片段的数量在1、3、5、10之间进行调整,以揭示整体趋势。

封闭检索。 除了向模型提供黄金片段这种较简单的设置外,还探索了更具挑战性的“开放环境”证据检索设置。在这种情况下,RAG系统首先需要检索在生成前从知识库中提取证据据此生成答案。

随后,通过余弦相似度与嵌入模型检索出与问题最相似的前10篇文档,并从每篇文档中选取最相似的句子作为证据片段。为与第一轮实验保持一致,选取的句子/文档数量也分别设置为1、3、5、10。 对于 QuoteSum,由于未提供维基百科文章子集,省略了此项实验。

开放检索。最后,在最具挑战性的开放场景下测试了这两个数据集的问答性能——即使用大型知识库,检索器首先需要从数百万份文档中筛选出最相关的文档。

与原始数据集中通常仅提供最多10个黄金片段不同,开放设置允许无限增加片段数量。因此,我们额外使用15、20、30个片段进行评估,以测试上下文饱和度的影响。

4.4 评估指标

ROUGE:它关注参考答案 与 生 成 答 案 之 间 的 召 回 率 。采 用ROUGE-L,该指标考察参考答案与生成答案之间最长的重叠序列。

BERTScore:该指标利用BERT模型的嵌入向量来捕捉语义相似性。

3. Ent%:该模型预测三种评分(蕴含、中性、矛盾)的平均蕴含评分报告。

生成答案与参考答案之间文本嵌入的平均余弦相似度(Cos),该指标侧重于这两串文本的语义相似性。

5. 结果

5.1 黄金片段

起初零样本性能较低,但仅使用一个上下文片段便能使性能大幅提升。此后,根据三项指标的测量结果,大多数模型的回答质量都呈现出缓慢而稳定的提升。

对于 BioASQ,Mixtral指标远超其他模型。这意味着其与参考答案的逻辑一致性更高。BioASQ 任务中表现的差异,可能源于不同模型所编码的生物医学知识水平存在差异。 在相关研究中,发现 Mixtral 和 Mistral 编码的生物医学知识比 GPT-4 更新且质量更高,而 Mistral 在生物医学问答任务上的表现优于领域专用的生物医学变体BioMistral。

对于 QuoteSum,情况则截然相反。GPT 模型表现最佳,其次是 LLaMa,而 Mixtral 则排名垫底。无上下文设置下的表现远低于任何基于上下文的设置,这表明该数据集中的问题高度依赖上下文。

1片段有助于显著提升性能,而后续的片段添加则带来更线性的提升。这一结论对LLaMa 3(8B)和Gemma(7B)同样成立。Mistral与其更大规模的版本Mixtral一样,在所有三项指标的衡量下均表现优异。

在片段5和10场景下,表现最佳的是Qwen(7B)。 在BioASQ任务中,即使与前表中规模大得多的LLaMa 3(70B)和GPT-4o相比,Mistral和Qwen也展现出了更强的性能和上下文利用能力,这表明模型规模并非RAG系统和综合问答中最重要的因素。 在QuoteSum任务中 ,Qwen的表现优于LLaMa 3(70B),而Mistral的表现则优于其更大规模的同类模型Mixtral。

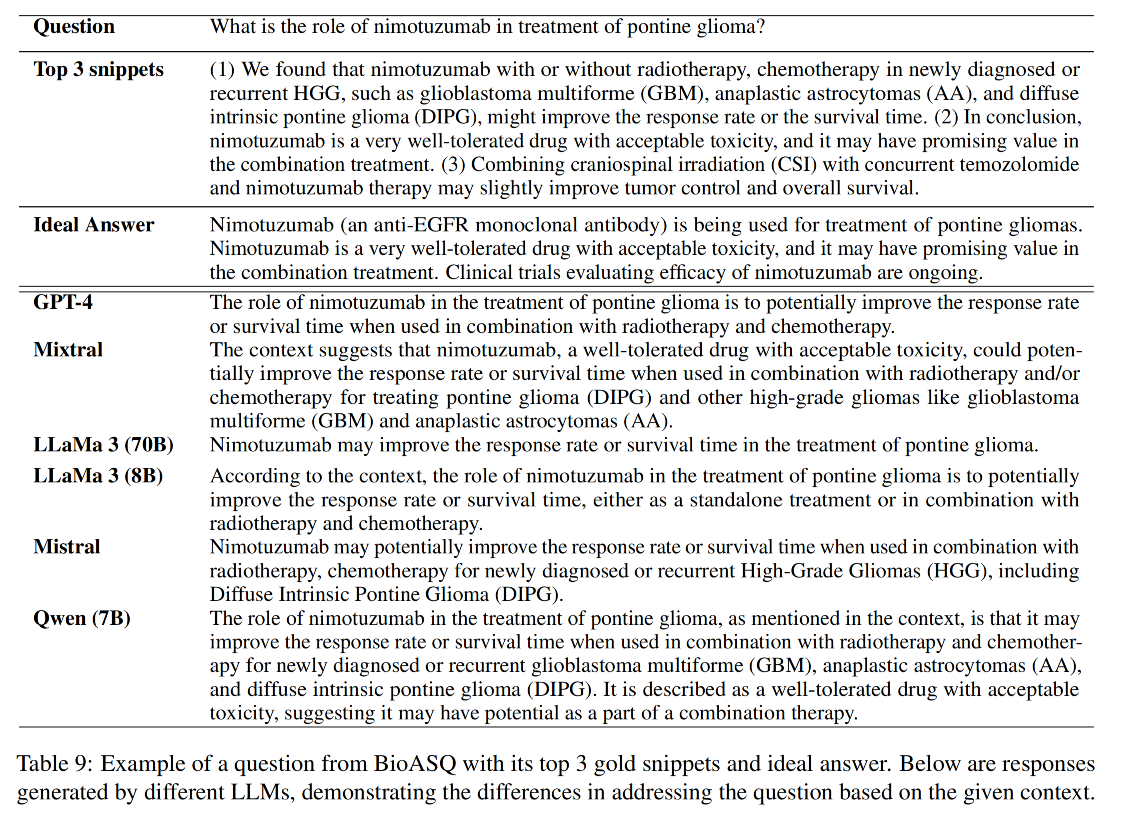

一个来自BioASQ的示例问题、其排名前三的黄金片段,以及数据集中的理想答案。随后,该表展示了不同大语言模型(LLMs)针对该问题及给定三个片段生成的回答,从而展示了基于给定上下文处理该问题时的差异。 Mixtral在保持简洁的同时似乎捕捉到了最多的细节,Qwen给出了最长的回答,而GPT-4o和LLaMa 3 (70B)则 遗 漏 了 一 些 关 键 细 节 。LLaMa 3 (8B)给出的回答比其更大规模的版本更具信息量。

5.2 闭环检索

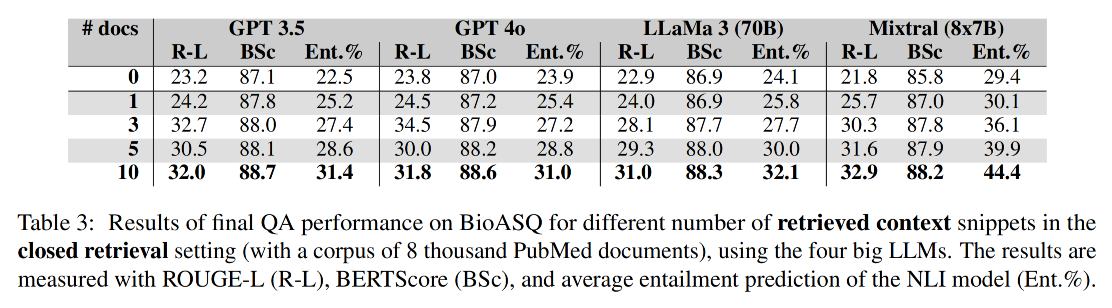

该设置使用了包含八千篇PubMed文章的小型知识库,这些文章在BioASQ中被用作黄金标准。

与表1相比,性能有所下降。即使是表现最佳的Mixtral模型,其性能也平均有所下降。尽管如此,性能仍在持续提升。

随着选取的前 k 个片段数量的增加,再次证明了上下文越多,性能就越好。这一点在前 10 个片段的设置中尤为明显,因为选取的证据片段越多,选取到用于生成理想答案的黄金证据片段的概率就越高。

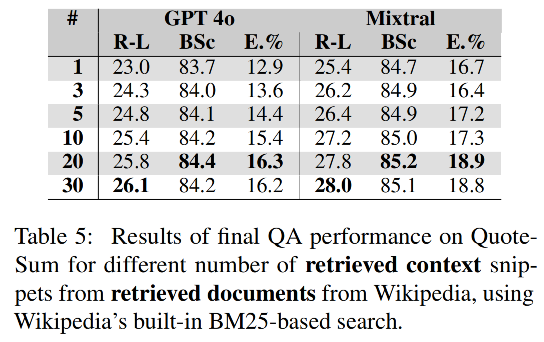

5.3 开放检索

的实验设置使用了约1000万篇PubMed文章作为检索的知识库。该实验旨在考察:(1)在开放设置下,系统性能与基于黄金标准证据的封闭设置相比有何差异;(2)不同的检索器对该性能有何影响。BioASQ的实验结果见表4,QuoteSum的实验结果见表5。

而对于维基百科,使用了基于BM25的搜索API。与前面的表格相比,很明显开放检索是最具挑战性的设置,其总体平均得分最低。值得注意的是,与语义搜索相比,使用BM25检索文档的最终性能略有提升。

6. 讨论

6.1 检索技术

从表3看出,BM25在整体上表现更佳。鉴于该算法基于关键词匹配,这种检索技术侧重于优化搜索结果的精确度而非召回率。这表明,优化精确度并将查询的关键词与知识库中的知识进行匹配,可以提升系统性能。特别是在生物医学问答等关键应用领域,优化精确度和提供稳健的答案,可能比语义搜索所提供的召回率更为重要。

6.2 内部知识与外部知识的冲突

表4关于开放检索,无论是GPT还是Mixtral,其零样本回答(仅使用0个上下文片段)的得分都高于使用多达10个上下文片段的回答。解释是:虽然语料库中发现的片段在语义上可能与问题相似,但它们并不总能提供所有重要信息。另一方面,当仅使用标准提示词时,LLM 会基于其“内部”知识进行回答——这些回答反映了 LLM 从大型预训练语料库中积累的知识。 因此,与要求LLM仅使用提供的短片段作答的RAG设置相比,LLM的内部回答可能更具信息量。随着片段数量的增加,RAG回答的信息量开始超越LLM的内部知识。近期研究还发现,

6.3 上下文饱和

表4中可见的另一项研究发现是,性能提升存在一定的上限。随着我们不断增加上下文(直至20个),性能增长停滞,而在检索30个上下文片段时,性能甚至略有下降。 一旦达到饱和点,向提示词中添加更多上下文只会导致回答中的噪声和混乱。