一、 引言:深度神经网络中的过拟合风险与正则化策略

在深度学习领域,模型的泛化能力(Generalization Ability)是衡量算法优劣的核心指标。随着网络深度的增加和参数量(Capacity)的指数级增长,深度神经网络展现出了极强的函数拟合能力。然而,这种强大的表达能力往往是一把双刃剑:当模型过度拟合训练数据中的噪声或特定样本特征,而非学习到底层的统计分布时,便会出现过拟合(Overfitting)现象。

1.1 过拟合的形式化定义

从经验风险最小化(Empirical Risk Minimization, ERM)的角度看,过拟合表现为训练误差(Training Error)极低,但泛化误差(Generalization Error)显著升高。在数学形式上,若模型的参数量 d 远大于有效样本量 n,模型极易陷入高方差(High Variance)陷阱,导致其在未见数据上的表现迅速恶化。

1.2 正则化在提高泛化能力中的必要性

为了抑制过拟合,研究者通常引入正则化(Regularization)技术。传统的正则化方法(如 L1 或 L2 范数惩罚)通过在损失函数中增加参数约束项,强制模型学习更平滑的解。

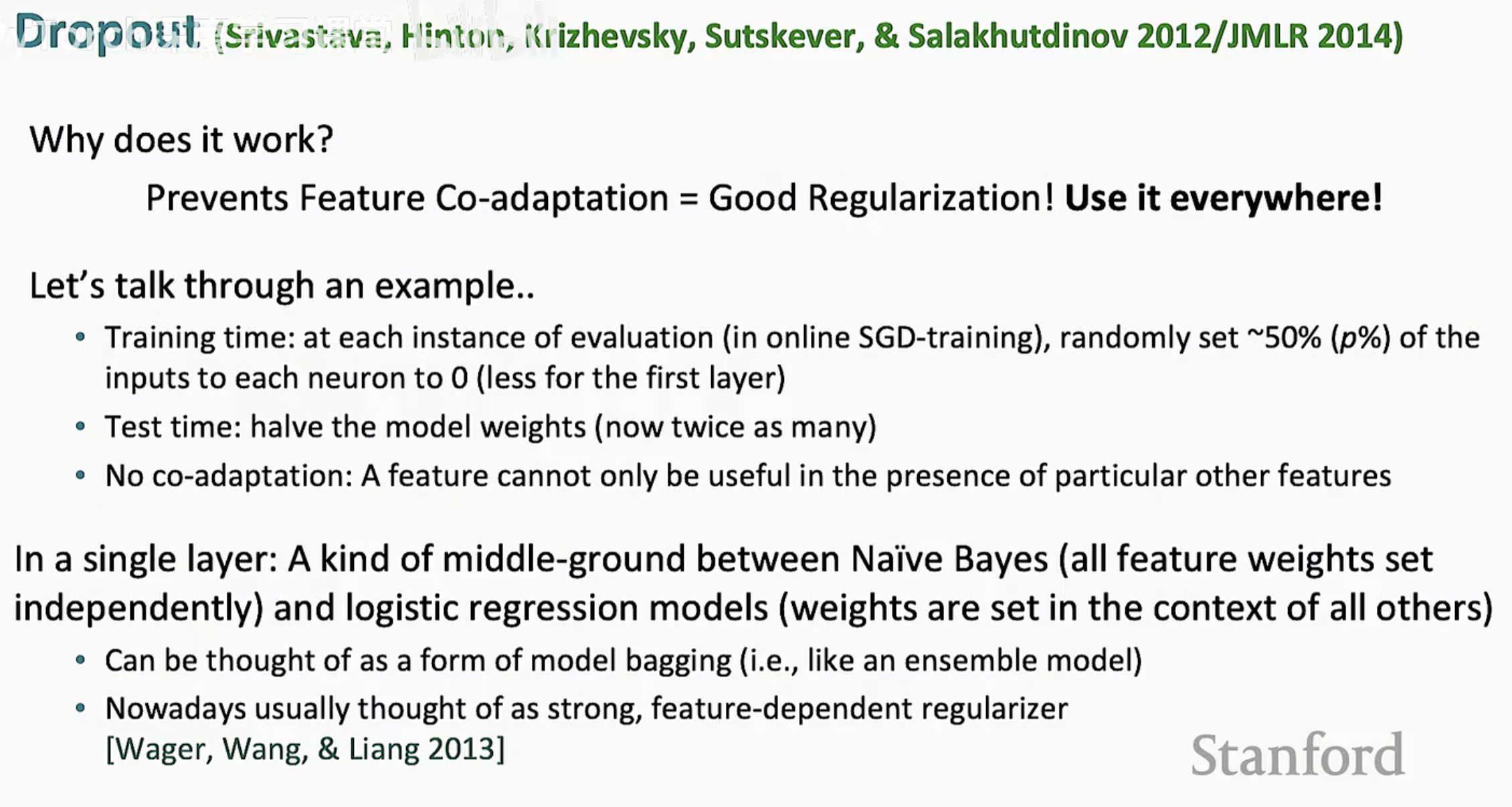

然而,对于结构高度复杂的深度神经网络,单纯的权值衰减(Weight Decay)往往难以完全解决神经元之间复杂的依赖关系。2012 年,Srivastava、Hinton 等人提出了 Dropout,这是一种通过在训练过程中改变网络计算图拓扑结构的随机过程。它不同于以往对参数数值的约束,而是通过引入结构化的噪声,迫使网络学习到更加鲁棒且独立(Robust and Independent)的特征表示。

二、 Dropout 的定义与算法流程

Dropout 的核心思想是在神经网络的训练过程中,以随机的方式临时“删除”一部分神经元。这一过程并非永久改变网络结构,而是针对每一个训练样本(或每一个 Mini-batch),独立地生成一个随机计算图。

2.1 训练阶段的随机丢弃机制

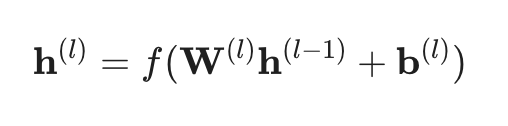

在标准的前馈神经网络中,第 l 层神经元的输出向量 h(l) 通常由下式给出:

其中 f 为激活函数。引入 Dropout 后,我们在计算下一层输入前,先对当前层的输出应用一个伯努利随机掩码(Bernoulli Mask)。

具体算法流程如下:

生成掩码向量:从伯努利分布中采样生成向量 r(l) ~ Bernoulli(1-p),其中 rj 包含于 {0, 1}。p 被称为 Dropout Ratio(丢弃率)。

应用掩码:将掩码与原始输出进行逐元素相乘(Hadamard Product):

前向传播:使用处理后的 ~h(l) 作为下一层的输入。

2.2 单次迭代下的网络拓扑演变

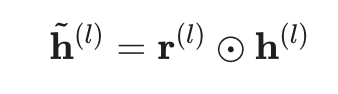

正如 图片 所展示的,Dropout 在每次迭代(Iteration)中都会强制网络进入不同的状态:

动态子网络采样:在

Train 1过程中,中间的两个神经元被随机置为 0,此时输出 y 仅由特征 x1、x3 及其对应的权重 w1、w3 决定。而在Train 2过程中,掩码发生了改变,计算图随之重构。计算图的精简:图片底部的公式清晰地反映了这种变化。在

Train 1时,y = w1x1 + w3x3 + b。这意味着在该次前馈和反向传播中,模型被迫只利用局部信息来完成预测任务。参数共享约束:尽管每一步训练的拓扑结构都在变化,但所有子网络共用同一套权重参数系数矩阵 W。这种机制迫使模型在极度不稳定的计算环境下,依然能够学习到具有普适性的特征。

2.3 参数选择与层级策略

根据 图片 提供的经验建议,丢弃率 $p$ 的设定通常具有启发式特征:

隐藏层(Hidden Layers):通常设定 p=0.5,此时随机组合的可能性最大,正则化效果最强。

输入层(Input Layer):为了保留原始输入信息的完整性,通常设定较低的丢弃率(如 p=0.15 或 0.2),仅剔除部分噪声特征。

三、 理论分析:Dropout 的有效性机理

在深度神经网络的训练过程中,简单地增加参数量往往会导致模型学习到一些仅在训练集上有效的“巧合”特征。Dropout 的引入从根本上改变了特征提取的逻辑。

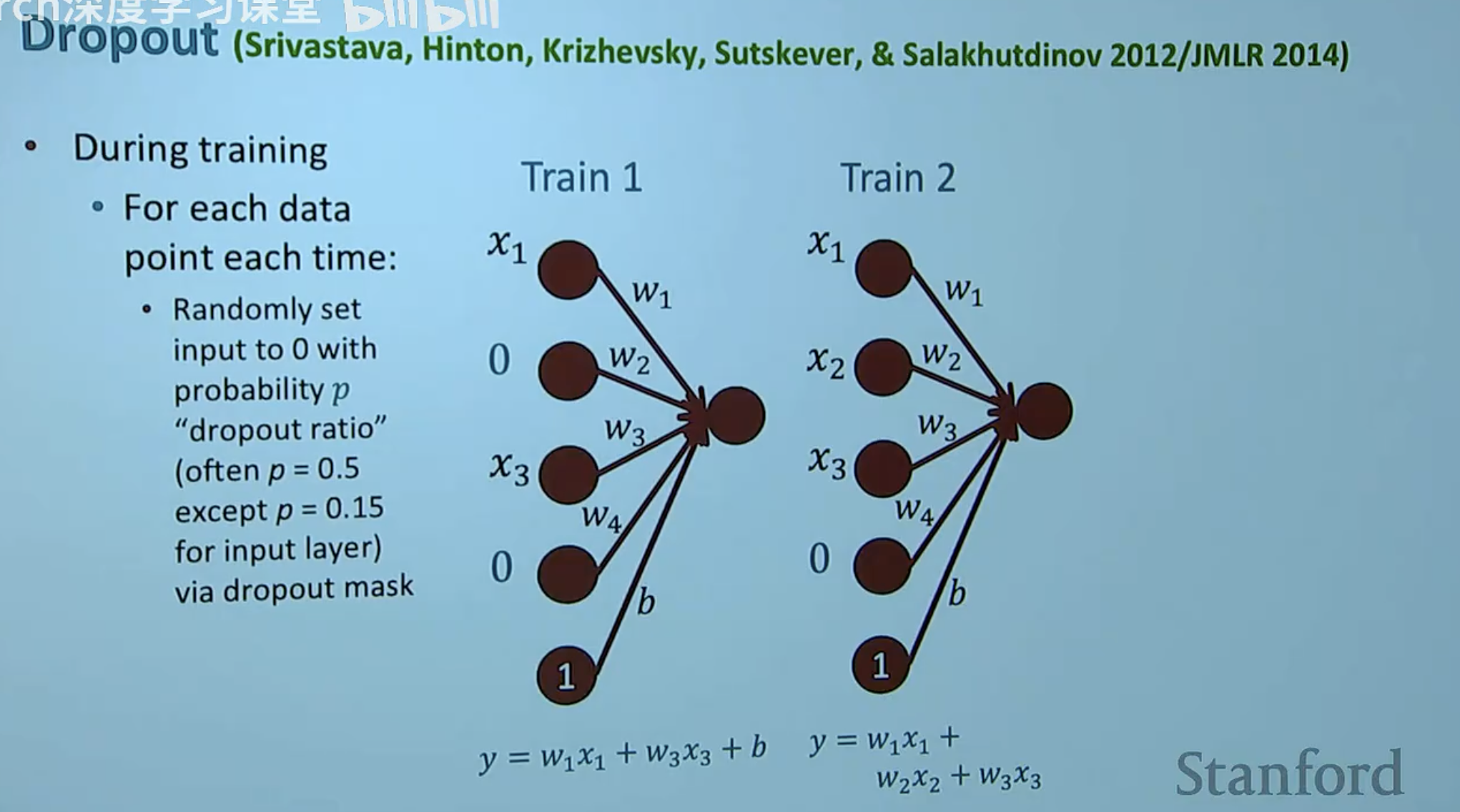

3.1 抑制特征共适应(Feature Co-adaptation)

图片明确指出了 Dropout 的核心贡献:防止特征共适应(Prevents Feature Co-adaptation)。

在标准神经网络中,神经元往往会演化出相互依赖的关系。例如,某个神经元可能只有在另外几个特定神经元同时激活时,才能修正其输出误差。这种复杂的互依赖关系被称为“共适应”。

脆弱性:共适应特征在训练集上表现优异,但在面对未见数据(测试集)的轻微扰动时极易失效。

独立性要求:通过随机丢弃 50% 的输入(如图片所示),Dropout 迫使每个神经元在“失去邻居辅助”的情况下依然能够提取有意义的特征。这意味着每个特征必须在多种不同的神经元组合中保持健壮性,从而实现了极佳的正则化效果。

3.2 模型集成的视角(Ensemble Learning Perspective)

从统计学习的角度看,Dropout 可以被视为一种高效的模型平均(Model Averaging)或装袋法(Bagging)的变体:

子网络空间:对于一个拥有 n 个神经元的网络,Dropout 在理论上可以产生 2n 个不同的子网络。

权值共享的集成:尽管我们在每次迭代中只训练一个子网络,但由于所有子网络共享同一套权值参数,最终训练完成的模型实际上是这 2n 个子网络的指数级集成。

贝叶斯近似:学术界(如 Wager 等人, 2013)的研究指出,Dropout 在单层逻辑回归中表现为一种特征相关的正则化项,其效果类似于在损失函数中引入了自适应的噪声。

3.3 朴素贝叶斯与逻辑回归的平衡

图片提到 Dropout 处于朴素贝叶斯(Naïve Bayes)与逻辑回归(Logistic Regression)的中间地带:

朴素贝叶斯假设特征之间完全独立(权重独立设置)。

逻辑回归则在所有特征共存的语境下设置权重。

Dropout 的中庸之道:它在保持特征间协作能力的同时,通过随机性引入了类似朴素贝叶斯的独立性约束,从而在模型复杂度和泛化性之间取得了平衡。

四、 推断阶段的数值一致性与权值缩放

在训练阶段,由于 Dropout 随机丢弃了部分神经元,网络输出的期望值与全量连接时存在显著差异。为了保证模型在测试(Test/Inference)阶段的预测准确性,必须对数值进行校正。

4.1 测试阶段的期望近似问题

如 图片 中“Test time”部分所述,训练时我们随机设置了约 50% 的输入为 0。这意味着在测试阶段,如果所有神经元全部激活,下一层接收到的信号强度将是训练时的两倍。

数学表达:若训练时的保留概率为 1-p,则神经元输出的期望为 E[htrain] = (1-p)h。

测试偏差:而在测试阶段,不使用 Dropout,输出为 htest = h。这种期望值的失配会导致激活函数(如 Sigmoid 或 ReLU)进入非预期的数值区间,从而使模型失效。

4.2 权值缩放(Weight Scaling)

为了弥补这一差距,早期的 Dropout 实现采取了权值缩放策略:

操作方法:在测试阶段,将所有学习到的权重 W 乘以保留概率 (1-p)。例如,p=0.5 时,即为“halve the model weights”。

物理意义:这等效于将 2n 个共享参数的子网络的预测结果取平均值。这种平滑处理确保了测试时的神经元响应与训练时的平均响应在量级上保持一致。

4.3 现代方案:反向随机丢弃(Inverted Dropout)

虽然图片描述的是测试时缩放,但现代深度学习框架(如 PyTorch, TensorFlow)通常采用 Inverted Dropout:

五、 实验观测与超参数敏感性分析

Dropout 的效果高度依赖于超参数的选择以及它在网络中所处的位置。

5.1 不同层的丢弃率设定建议

参考 图片 1 的标注,丢弃率并非全局统一:

隐藏层(p ≈ 0.5):这是最常用的设置。由于隐藏层负责提取高阶抽象特征,较高的丢弃率能最大程度地破坏特征间的冗余耦合。

输入层(p ≈ 0.15 或更低):输入层直接对应原始特征(如像素或词向量)。过高的丢弃率会导致底层信息严重丢失,难以恢复,因此通常设定较小的值。

5.2 模型的容量与训练时长

模型容量(Capacity):使用 Dropout 时,通常需要比不使用 Dropout 时更宽的网络(更多神经元),以弥补丢弃带来的信息折损。

收敛速度:由于每次迭代都在训练不同的子网络,Dropout 往往会减慢训练过程,需要更多的迭代次数才能达到收敛,但最终获得的模型鲁棒性显著更强。